Rask oversikt

Dette innlegget vil demonstrere følgende:

- Hvordan få tilgang til mellomtrinnene til en agent i LangChain

- Installere Frameworks

- Innstilling av OpenAI-miljø

- Importerer biblioteker

- Bygge LLM og agent

- Bruke agenten

- Metode 1: Standard returtype for å få tilgang til mellomtrinnene

- Metode 2: Bruk 'dumps' for å få tilgang til mellomtrinnene

- Konklusjon

Hvordan få tilgang til mellomtrinnene til en agent i LangChain?

For å bygge agenten i LangChain, må brukeren konfigurere verktøyene og strukturen til malen for å få antall trinn involvert i modellen. Agenten er ansvarlig for å automatisere de mellomliggende trinnene som tanker, handlinger, observasjoner osv. For å lære hvordan du får tilgang til mellomtrinnene til en agent i Langkjeden, følg ganske enkelt trinnene som er oppført:

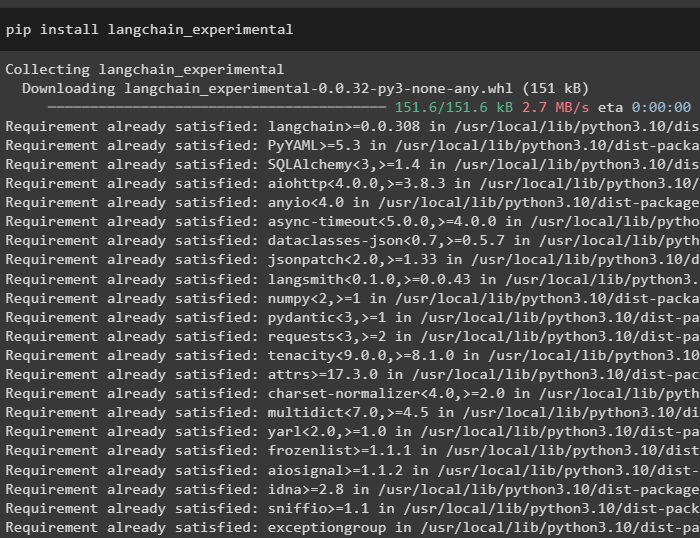

Trinn 1: Installere Frameworks

Først av alt, installer ganske enkelt avhengighetene til LangChain ved å kjøre følgende kode i Python Notebook:

pip installer langchain_experimental

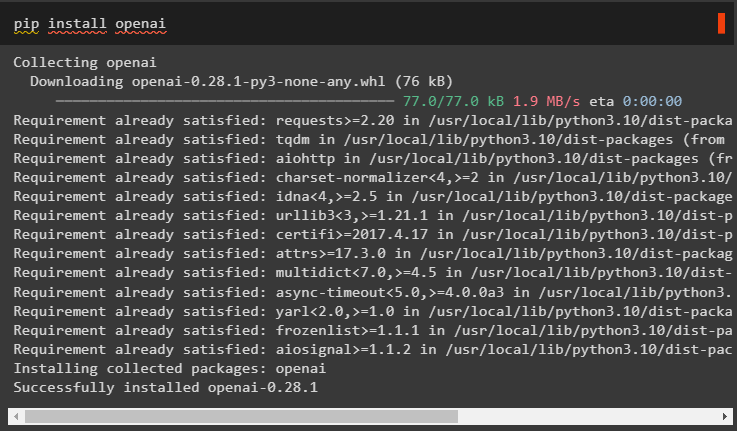

Installer OpenAI-modulen for å få dens avhengigheter ved å bruke pip kommando og bruk dem til å bygge språkmodellen:

pip installer openai

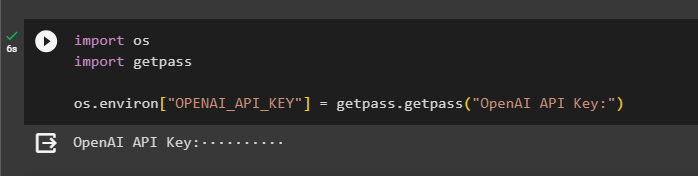

Trinn 2: Innstilling av OpenAI-miljø

Når modulene er installert, setter du opp OpenAI-miljø ved å bruke API-nøkkelen generert fra kontoen:

import du

import få pass

du. omtrent [ 'OPENAI_API_KEY' ] = få pass. få pass ( 'OpenAI API Key:' )

Trinn 3: Importere biblioteker

Nå som vi har avhengighetene installert, bruk dem til å importere biblioteker fra LangChain:

fra langchain. agenter import load_toolsfra langchain. agenter import initialize_agent

fra langchain. agenter import AgentType

fra langchain. llms import OpenAI

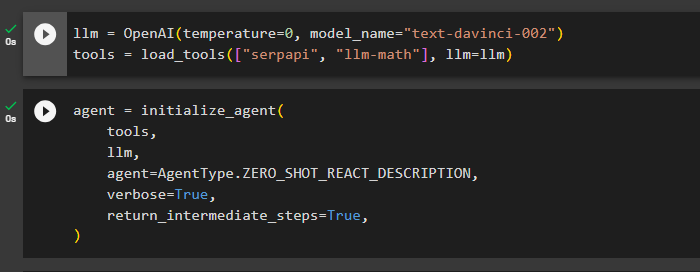

Trinn 4: Bygg LLM og agent

Når bibliotekene er importert, er det på tide å bruke dem til å bygge språkmodellen og verktøyene for agenten. Definer llm-variabelen og tilordne den med OpenAI()-metoden som inneholder temperatur- og modellnavn-argumentene. « verktøy Variabelen inneholder load_tools()-metoden med SerpAPi- og llm-math-verktøyene og språkmodellen i argumentet:

llm = OpenAI ( temperatur = 0 , modell navn = 'text-davinci-002' )verktøy = load_tools ( [ 'serpapi' , 'llm-matte' ] , llm = llm )

Når språkmodellen og verktøyene er konfigurert, kan du enkelt designe agenten for å utføre de mellomliggende trinnene ved å bruke verktøyene i språkmodellen:

middel = initialize_agent (verktøy ,

llm ,

middel = AgentType. ZERO_SHOT_REACT_DESCRIPTION ,

ordrik = ekte ,

retur_mellomtrinn = ekte ,

)

Trinn 5: Bruke agenten

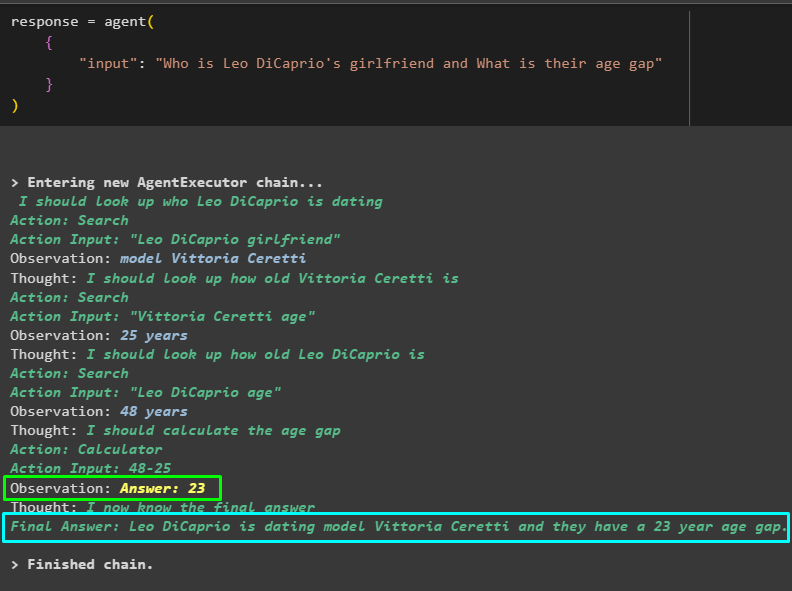

Sett nå agenten på prøve ved å stille et spørsmål i inndataene til agent()-metoden og utføre det:

respons = middel ({

'inngang' : 'Hvem er Leo DiCaprios kjæreste og hva er aldersforskjellen deres'

}

)

Modellen har jobbet effektivt for å få navnet på Leo DiCaprios kjæreste, hennes alder, Leo DiCaprios alder, og forskjellen mellom dem. Følgende skjermbilde viser flere spørsmål og svar søkt av agenten for å komme til det endelige svaret:

Skjermbildet ovenfor viser ikke hvordan agenten fungerer og hvordan den kommer til det stadiet for å finne alle svarene. La oss gå til neste seksjon for å finne trinnene:

Metode 1: Standard returtype for å få tilgang til mellomtrinnene

Den første metoden for å få tilgang til det mellomliggende trinnet er å bruke standard returtype som tilbys av LangChain ved å bruke følgende kode:

skrive ut ( respons [ 'mellomsteg' ] )Følgende GIF viser de mellomliggende trinnene på en enkelt linje som ikke er helt bra når det gjelder lesbarhetsaspektet:

Metode 2: Bruk 'dumps' for å få tilgang til mellomtrinnene

Den neste metoden forklarer en annen måte å få de mellomliggende trinnene ved å bruke dump-biblioteket fra LangChain-rammeverket. Bruk dumps()-metoden med det pene argumentet for å gjøre utdataene mer strukturerte og enkle å lese:

fra langchain. laste . dump import dumperskrive ut ( dumper ( respons [ 'mellomsteg' ] , ganske = ekte ) )

Nå har vi utdataene i en mer strukturert form som er lett lesbar for brukeren. Den er også delt inn i flere seksjoner for å gi mer mening, og hver seksjon inneholder trinnene for å finne svar på spørsmålene:

Det handler om å få tilgang til mellomtrinnene til en agent i LangChain.

Konklusjon

For å få tilgang til mellomtrinnene til en agent i LangChain, installer modulene for å importere biblioteker for å bygge språkmodeller. Deretter setter du opp verktøy for å initialisere agenten ved å bruke verktøyene, llm og typen agent som kan svare på spørsmålene. Når agenten er konfigurert, test den for å få svarene og bruk deretter standardtypen eller dumps-biblioteket for å få tilgang til de mellomliggende trinnene. Denne veiledningen har utdypet prosessen med å få tilgang til mellomtrinnene til en agent i LangChain.