Rask oversikt

Dette innlegget vil demonstrere:

Hvordan implementere ReAct-logikken med Document Store i LangChain

- Installere Frameworks

- Leverer OpenAI API-nøkkel

- Importerer biblioteker

- Bruker Wikipedia Explorer

- Tester modellen

Hvordan implementere ReAct-logikken med Document Store i LangChain?

Språkmodellene er trent på en enorm pool av data skrevet på naturlige språk som engelsk, etc. Dataene administreres og lagres i dokumentlagrene og brukeren kan enkelt laste inn data fra butikken og trene modellen. Modellopplæringen kan ta flere iterasjoner ettersom hver iterasjon gjør modellen mer effektiv og forbedret.

For å lære prosessen med å implementere ReAct-logikk for å jobbe med dokumentlageret i LangChain, følg ganske enkelt denne enkle veiledningen:

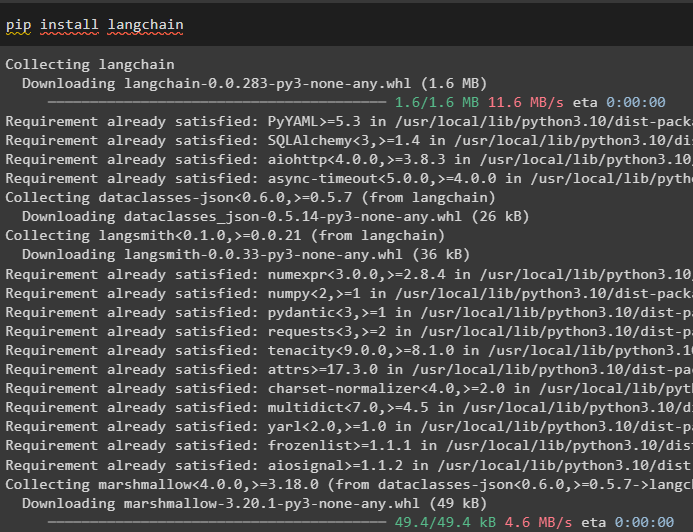

Trinn 1: Installere Frameworks

Først, kom i gang med prosessen med å implementere ReAct-logikken for å jobbe med dokumentlageret ved å installere LangChain-rammeverket. Installering av LangChain-rammeverket vil få alle nødvendige avhengigheter for å hente eller importere bibliotekene for å fullføre prosessen:

pip installer langkjede

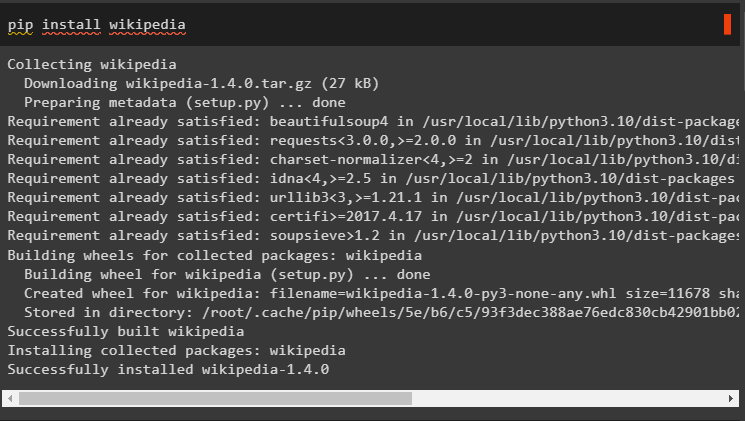

Installer Wikipedia-avhengighetene for denne veiledningen, da den kan brukes til å få dokumentlagrene til å fungere med ReAct-logikken:

pip installer wikipedia

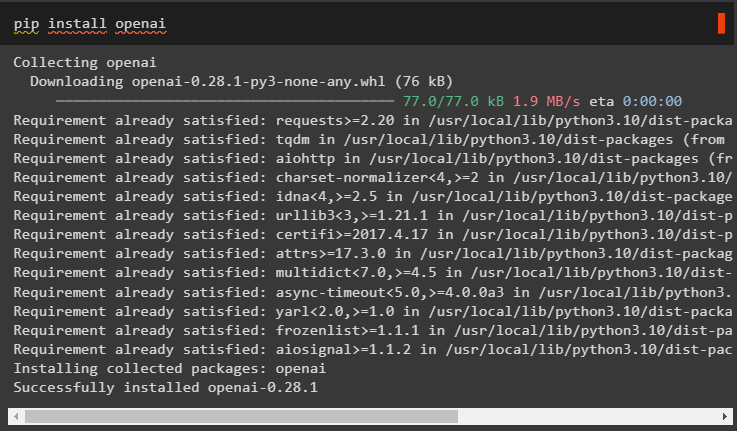

Installer OpenAI-modulene ved å bruke pip-kommandoen for å hente bibliotekene og bygge store språkmodeller eller LLM-er:

pip installer openai

Trinn 2: Oppgi OpenAI API-nøkkel

Etter å ha installert alle nødvendige moduler, ganske enkelt sette opp miljøet ved å bruke API-nøkkelen fra OpenAI-kontoen ved å bruke følgende kode:

import duimport få pass

du . omtrent [ 'OPENAI_API_KEY' ] = få pass . få pass ( 'OpenAI API Key:' )

Trinn 3: Importere biblioteker

Når miljøet er satt opp, importerer du bibliotekene fra LangChain som kreves for å konfigurere ReAct-logikken for arbeid med dokumentlagrene. Bruk av LangChain-agenter for å få DocstoreExplaorer og agenter med dens typer til å konfigurere språkmodellen:

fra langkjede. llms import OpenAIfra langkjede. lege import Wikipedia

fra langkjede. agenter import initialize_agent , Verktøy

fra langkjede. agenter import AgentType

fra langkjede. agenter . reagere . utgangspunkt import DocstoreExplorer

Trinn 4: Bruke Wikipedia Explorer

Konfigurer ' lege ” variabel med DocstoreExplorer()-metoden og kall Wikipedia()-metoden i argumentet. Bygg den store språkmodellen ved å bruke OpenAI-metoden med ' tekst-davinci-002 modell etter å ha satt verktøyene for agenten:

lege = DocstoreExplorer ( Wikipedia ( ) )verktøy = [

Verktøy (

Navn = 'Søk' ,

func = lege. Søk ,

beskrivelse = 'Den brukes til å stille spørsmål/forespørsler med søket' ,

) ,

Verktøy (

Navn = 'Se opp' ,

func = lege. se opp ,

beskrivelse = 'Den brukes til å stille spørsmål/forespørsler med oppslag' ,

) ,

]

llm = OpenAI ( temperatur = 0 , modell navn = 'text-davinci-002' )

#definere variabelen ved å konfigurere modellen med agenten

reagere = initialize_agent ( verktøy , llm , middel = AgentType. REACT_DOCSTORE , ordrik = ekte )

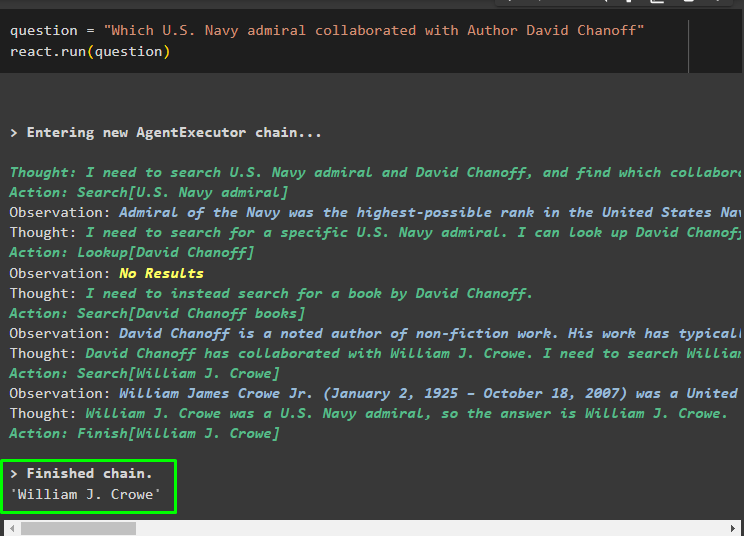

Trinn 5: Testing av modellen

Når modellen er bygget og konfigurert, setter du spørsmålsstrengen og kjører metoden med spørsmålsvariabelen i argumentet:

spørsmål = 'Hvilken amerikanske marineadmiral samarbeidet med forfatter David Chanoff'reagere. løpe ( spørsmål )

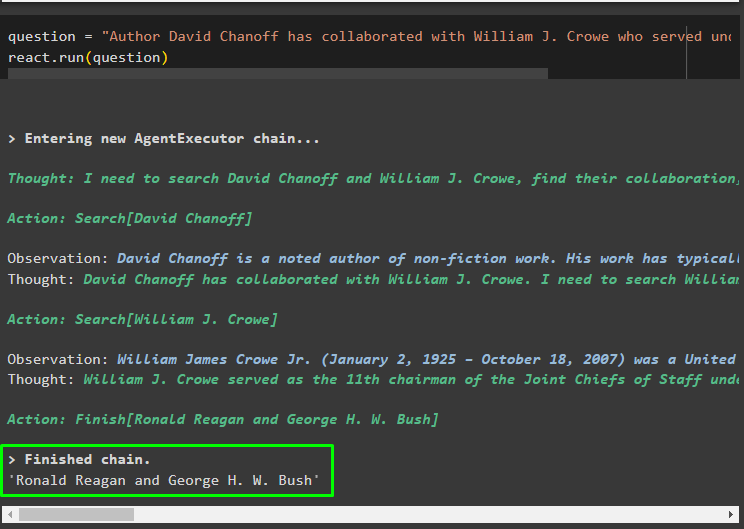

Når spørsmålsvariabelen er utført, har modellen forstått spørsmålet uten noen ekstern forespørselsmal eller opplæring. Modellen trenes automatisk ved å bruke modellen lastet opp i forrige trinn og genererer tekst deretter. ReAct-logikken jobber med dokumentlagrene for å trekke ut informasjon basert på spørsmålet:

Still et annet spørsmål fra dataene gitt til modellen fra dokumentlagrene, og modellen vil trekke ut svaret fra butikken:

spørsmål = 'Forfatter David Chanoff har samarbeidet med William J Crowe som tjente under hvilken president?'reagere. løpe ( spørsmål )

Det handler om å implementere ReAct-logikken for å jobbe med dokumentlageret i LangChain.

Konklusjon

For å implementere ReAct-logikken for arbeid med dokumentlageret i LangChain, installer modulene eller rammeverket for å bygge språkmodellen. Sett deretter opp miljøet for OpenAI for å konfigurere LLM og last inn modellen fra dokumentlageret for å implementere ReAct-logikken. Denne veiledningen har utdypet implementeringen av ReAct-logikken for arbeid med dokumentlageret.