I denne epoken er Transformers de kraftigste modellene som har gitt de beste resultatene i flere NLP-operasjoner (Natural Language Processing). Opprinnelig ble det brukt til språkmodelleringsoppgaver inkludert tekstgenerering samt klassifisering, maskinoversettelse og mange flere. Men nå brukes den også til objektgjenkjenning, bildeklassifisering og flere andre datasynsoppgaver.

I denne opplæringen vil vi gi prosedyren for å utføre tekstklassifiseringen ved hjelp av Transformers.

Hvordan utføre tekstklassifisering ved hjelp av transformatorer?

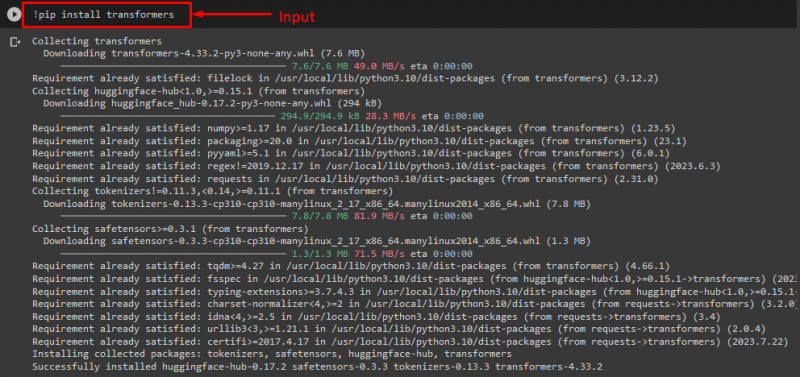

For å utføre tekstklassifiseringen ved hjelp av Transformers, installer først ' transformatorer ”-biblioteket ved å utføre den angitte kommandoen:

! pip installere transformatorer

Som du kan se, har det angitte biblioteket blitt installert:

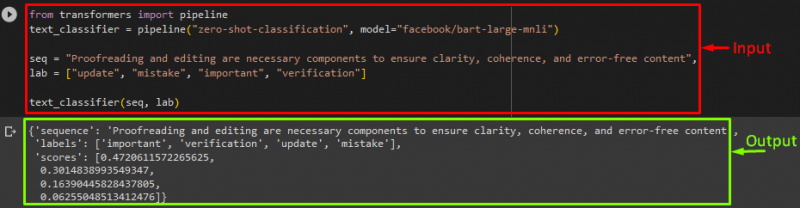

Importer deretter ' rørledning ' fra ' transformatorer ' bibliotek:

fra transformatorer import rørledning

Her er ' rørledning ” vil inkludere NLP-oppgaven som vi må utføre og ønsket transformatormodell for denne operasjonen sammen med tokenizeren.

Merk: Tokenizeren brukes til å utføre prosessering av teksten som skal gis modellens input ved å separere tekst i tokens.

Etter det bruker du ' pipeline() '-funksjonen og gi den ' nullskuddsklassifisering ' som et argument. Deretter sender du en annen parameter som er vår modell. Vi bruker Facebooks ' BART ' transformatormodell. Her bruker vi ikke tokenizeren fordi den automatisk kan utledes av den angitte modellen:

text_classifier = pipeline ( 'nullskuddsklassifisering' , modell = 'facebook/bart-large-mnli' )

Nå, erklær ' seq ”-variabel som inneholder vår inndatatekst som må klassifiseres. Deretter gir vi kategoriene som vi ønsker å klassifisere teksten i og lagre i ' lab ' som er kjent som etiketter:

lab = [ 'Oppdater' , 'feil' , 'viktig' , 'bekreftelse' ]

Til slutt kjører du rørledningen sammen med inngangen:

Etter å ha utført rørledningen, som du kan se, spådde modellen at sekvensen vår ble klassifisert:

Ytterligere informasjon: Hvis du vil øke ytelsen til modellen, må du bruke GPU. Hvis ja, for det formålet kan du spesifisere et enhetsargument til rørledningen og sette det til ' 0 ' for å bruke GPU.

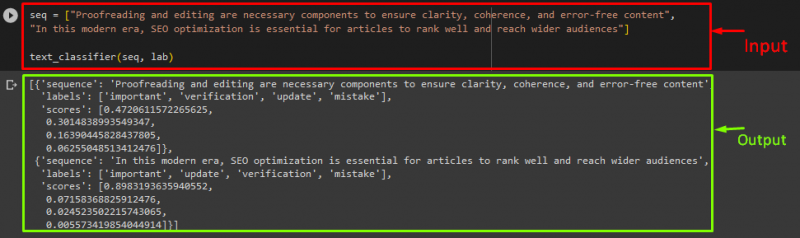

Hvis du vil klassifisere teksten på mer enn én sekvens/inndatatekstsetning, kan du legge dem til en liste og sende den som input til rørledningene. For det formålet, sjekk ut kodebiten:

seq = [ 'Korrekturlesing og redigering er nødvendige komponenter for å sikre klarhet, sammenheng og feilfritt innhold' ,'I denne moderne tid er SEO-optimalisering avgjørende for at artikler skal rangeres godt og nå bredere målgrupper' ]

tekstklassifiserer ( seq , lab )

Produksjon

Det er det! Vi har samlet den enkleste måten for å utføre tekstklassifiseringen ved hjelp av Transformers.

Konklusjon

Transformatorer brukes til å utføre språkmodelleringsoppgaver, som tekstgenerering, tekstklassifisering og maskinoversettelse, samt datasynsoppgaver inkludert objektgjenkjenning og bildeklassifisering. I denne opplæringen har vi illustrert prosessen for å utføre tekstklassifisering ved hjelp av Transformers.