Syntaks:

Ettersom vi er kjent med ChatGPT, vet vi at denne plattformen eies av Open AI-fellesskapet og den gir verktøy, arkitekturer, APIer og flere rammeverk som vi kan bruke i distribusjonen av applikasjonene våre og de naturlige språkbehandlingsmodellene. Open AI tilbyr API-ene som vi kan bruke alle forhåndstrente AI- og NLP-modeller fra Open AI-plattformen og kan få dem til å fungere for våre applikasjoner som for eksempel å gi spådommer om sanntidsdata. På samme måte gir GPT4All også sine brukere å integrere sine ferdigtrente AI-modeller med forskjellige applikasjoner.

GPT4All-modellen er trent på begrensede data sammenlignet med ChatGPT. Den har også noen av ytelsesbegrensningene sammenlignet med ChatGPT, men den lar brukeren bruke sin private GPT på sin lokale maskinvare, og den krever ingen nettverkstilkoblinger. Ved hjelp av denne artikkelen vil vi bli kjent med hvordan vi kan bruke GPT4All-modellene i Python-skriptet siden GPT4All har de offisielle bindingene med Python som gjør at vi kan bruke og integrere GPT4All-modellene også gjennom Python-skriptet.

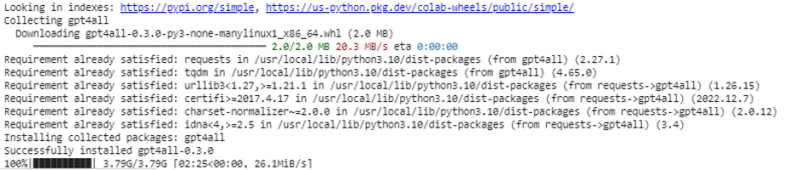

Det hele krever en online-kommando for å installere GPT4All for Python IDE. Deretter kan vi integrere like mange AI-modeller som applikasjonene våre. Kommandoen for å installere denne GPT4All i Python er som vist i følgende:

$ pip installer gpt4all

Eksempel 1:

For å komme i gang med dette eksemplet, må vi laste ned og installere Python i systemene våre. De anbefalte versjonene av Python er 'versjon 3.7' eller de som kom etter denne versjonen. En annen måte å jobbe med Python på for å unngå den lange prosessen med å installere 'Python-oppsettet' på systemene våre, er å bruke 'Google Colab' som er et skybasert miljø for Python. Vi kan kjøre dette miljøet på hvilken som helst nettleser og kan bygge AI og maskinlæringsmodeller. Eksemplene som vi skal implementere her er utført i Google Colab.

Dette eksemplet dekker metoden for å installere GPT4All i Python og hvordan du bruker de forhåndstrente modellene. Vi begynner med først å installere GPT4All. For det utføres kommandoen som vi tidligere nevnte. Med utførelse av kommandoen blir GPT4All sammen med pakkene og rammeverket lastet ned og installert.

Nå går vi videre. Fra GPT4All importerer vi 'GPT4All'. Dette legger alle de ferdigtrente modellene fra GPT4All til prosjektet. Nå kan vi bruke hvilken som helst enkelt modell og få den til å gjøre spådommene for applikasjonen vår. Når vi importerer GPT4All-pakken, er det nå på tide å kalle denne funksjonen og bruke GPT4All-modellen som gir utdata for 'chatfullføringen'.

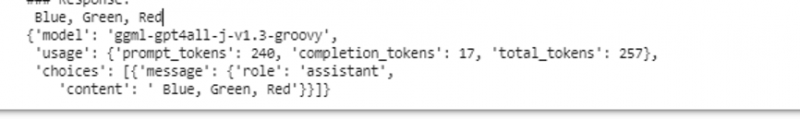

Med andre ord, hvis vi spør om noe fra den modellen i inngangen, returnerer den det i utdata. Modellen vi bruker her er 'ggml-gpt4all-j-v1.3-groovy'. Disse modellene er allerede lagret i GPT4All-bufferen. Vi kan få disse modellene fra denne lenken ' https://github.com/nomic-ai/gpt4all/tree/main/gpt4all-chat ' for manuell nedlasting. Hvis modellen allerede er til stede i GPT4All-hurtigbufferen, kaller vi bare navnet på modellen og spesifiserer det som inngangsparametere til 'GPT4All()'-funksjonen. Hvis vi lastet den ned manuelt, sender vi banen til mappen der modellen er plassert. Siden denne modellen er for meldingsfullføring, er syntaksen for denne modellen gitt som følger:

$ Chat_completion (meldinger)Meldingene er en ordbokliste, og hver ordbok skal inneholde en 'rolle'-nøkkel med en verdi for brukeren, systemet eller assistenten, og 'nøkkelen'-innholdet som har verdien som strengen. I dette eksemplet spesifiserer vi innholdet som «navn tre farger» og rollenøkkelen som «bruker».

$model= GPT4All('ggml-gpt4all-j-v1.3-groovy')$messages = [{'role': 'bruker', 'content': 'Nevn 3 blomster'}]

Etter denne spesifikasjonen kaller vi funksjonen 'chat_completion()' med modellen. Koden for dette vises i følgende utgang:

$ !pip installer gpt4allfra gpt4all import GPT4All

modell = GPT4All('ggml-gpt4all-j-v1.3-groovy')

meldinger = [{'role': 'bruker', 'content': 'Nevn tre farger'}]

model.chat_completion(meldinger)

Etter utførelse av dette eksemplet returnerer modellen tre farger som respons på input.

Eksempel 2:

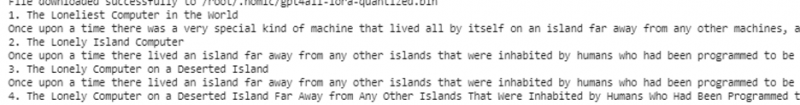

Vi dekker et annet eksempel der vi oppdager en annen metode for å bruke GPT4All i Python. Dette kan gjøres ved å bruke de offisielle bindingene for Python som er levert av 'Nomic' som er et åpen kildekode AI-fellesskap, og det kjører GPT4All. Ved å bruke følgende kommando integrerer vi 'nomic' i Python-konsollen vår:

$ pip installer nomicNår dette er installert, importerer vi GPT4All fra 'nomic.gpt4all'. Etter å ha importert GPT4All, initialiserer vi GPT4All med 'open()'-funksjonen. Deretter kaller vi 'prompt()'-funksjonen og sender en ledetekst til denne funksjonen. Deretter genereres en prompt respons basert på prompten som vi har gitt som input til promptmodellen.

!pip installer nomicfra nomic.gpt4all importerer GPT4All

# Initialiser GPT4All-modellen

initiere = GPT4All()

initiate.open()

# Genererer et svar basert på ledeteksten

model_response = initiate.prompt('skriv en novelle om en datamaskin)

# viser det genererte svaret

print(modell_svar)

Utdataene viser det raske svaret fra modellen som vi genererte ved å bruke den forhåndstrente GPT4All-modellen i Python. Hvis vi ønsker å vite mer om modellene og hvordan vi kan bruke disse modellene til å generere responsene, eller med enkle ord, hvis vi ønsker å få kunnskap om syntaksen for å generere responsene fra disse modellene, kan vi ta ytterligere hjelp fra GPT4All teknisk dokumentasjonsdetaljer.

Konklusjon

GPT4All streber fortsatt etter å oppnå ytelsesnøyaktighet. Den drives av den nomic AI-plattformen som tar sikte på å tilby kunstig intelligente chatbots til brukerne på forbruker-CPUer siden GPT4All fungerer uten nettverkstilkobling og GPUer. Denne artikkelen opplyser oss til å dyktig bruke PyGPT4All i et Python-miljø og for å skape en interaksjon mellom applikasjonene våre og de forhåndstrente GPT4All AI-modellene. Vi dekket to forskjellige metoder for hvordan du installerer GPT4All i Python i denne veiledningen.