Denne veiledningen vil illustrere prosessen med å laste kjeder fra LangChain Hub.

Hvordan legge til minnetilstand i kjede ved hjelp av LangChain?

Minnetilstand kan brukes til å initialisere kjedene, da den kan referere til den nylige verdien som er lagret i kjedene som vil bli brukt mens du returnerer utdata. For å lære prosessen med å legge til en minnetilstand i kjeder ved hjelp av LangChain-rammeverket, gå ganske enkelt gjennom denne enkle guiden:

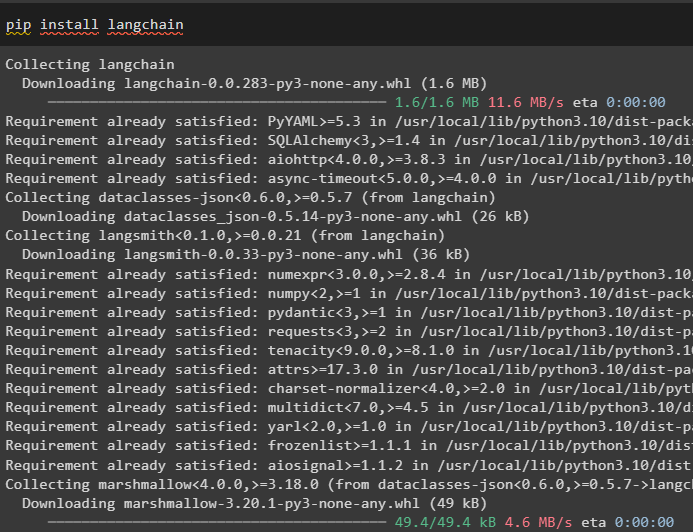

Trinn 1: Installer moduler

Kom først inn i prosessen ved å installere LangChain-rammeverket med dets avhengigheter ved å bruke pip-kommandoen:

pip installer langkjede

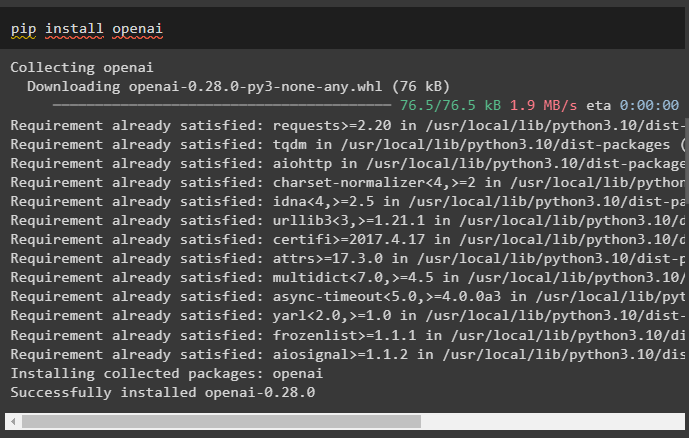

Installer OpenAI-modulen også for å få bibliotekene som kan brukes til å legge til minnetilstand i kjeden:

pip installer openai

Få API-nøkkelen fra OpenAI-kontoen og sette opp miljøet bruke den slik at kjedene kan få tilgang til den:

import du

import få pass

du . omtrent [ 'OPENAI_API_KEY' ] = få pass . få pass ( 'OpenAI API Key:' )

Dette trinnet er viktig for at koden skal fungere skikkelig.

Trinn 2: Importer biblioteker

Etter å ha satt opp miljøet, importerer du bare bibliotekene for å legge til minnetilstanden som LLMChain, ConversationBufferMemory og mange flere:

fra langkjede. kjeder import Samtalekjedefra langkjede. hukommelse import ConversationBufferMemory

fra langkjede. chat_modeller import ChatOpenAI

fra langkjede. kjeder . llm import LLMChain

fra langkjede. spør import PromptTemplate

Trinn 3: Bygg kjeder

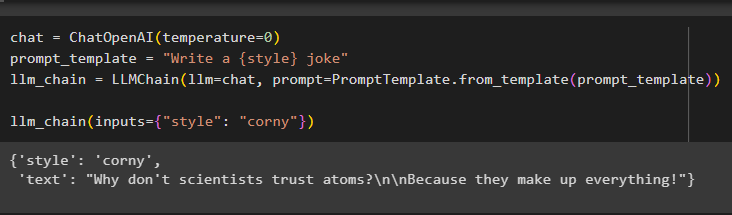

Nå bygger du ganske enkelt kjeder for LLM ved å bruke OpenAI()-metoden og malen for ledeteksten ved å bruke spørringen for å kalle kjeden:

chatte = ChatOpenAI ( temperatur = 0 )prompt_mal = 'Skriv en {style}-vits'

llm_chain = LLMChain ( llm = chatte , ledetekst = PromptTemplate. fra_mal ( prompt_mal ) )

llm_chain ( innganger = { 'stil' : 'rar' } )

Modellen har vist utdataene ved å bruke LLM-modellen som vist på skjermbildet nedenfor:

Trinn 4: Legge til minnetilstand

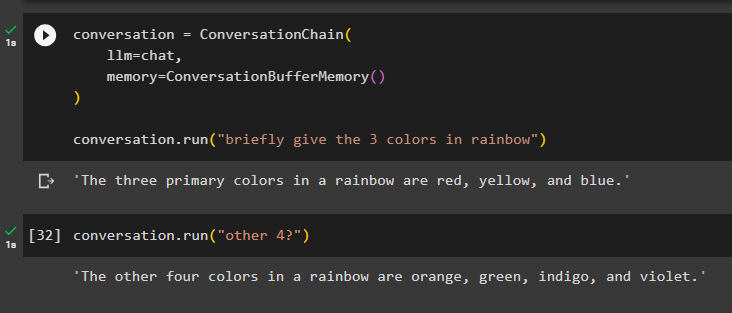

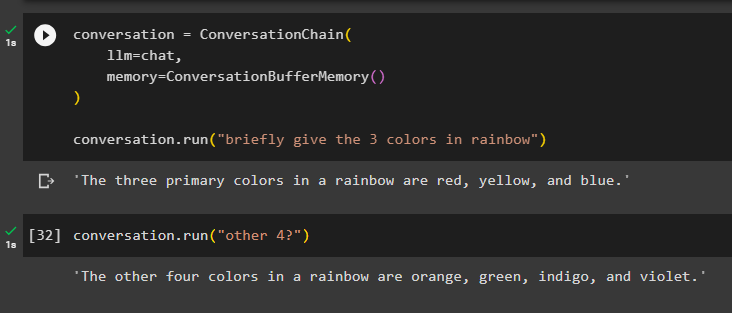

Her skal vi legge til minnetilstanden i kjeden ved å bruke ConversationBufferMemory()-metoden og kjøre kjeden for å få 3 farger fra regnbuen:

samtale = Samtalekjede (llm = chatte ,

hukommelse = ConversationBufferMemory ( )

)

samtale. løpe ( 'gi kort de 3 fargene i regnbuen' )

Modellen har bare vist tre regnbuens farger, og konteksten er lagret i minnet til kjeden:

Her kjører vi kjeden med en tvetydig kommando som ' andre 4? ” slik at modellen selv får konteksten fra minnet og viser de resterende regnbuefargene:

samtale. løpe ( 'andre 4?' )Modellen har gjort akkurat det, ettersom den forsto konteksten og returnerte de resterende fire fargene fra regnbuesettet:

Det handler om lastekjeder fra LangChain Hub.

Konklusjon

For å legge til minnet i kjeder ved hjelp av LangChain-rammeverket, installer ganske enkelt moduler for å sette opp miljøet for å bygge LLM. Etter det importerer du bibliotekene som kreves for å bygge kjedene i LLM og legger deretter til minnetilstanden til den. Etter å ha lagt til minnetilstanden til kjeden, gi ganske enkelt en kommando til kjeden for å få utdata og deretter gi en annen kommando innenfor konteksten av den forrige for å få riktig svar. Dette innlegget har utdypet prosessen med å legge til en minnetilstand i kjeder ved å bruke LangChain-rammeverket.