LangChain er rammeverket med applikasjonen i Natural Language Processing eller NLP-domenet for å bygge modeller på menneskelignende språk. Disse modellene kan brukes av mennesker for å få svar fra modellen eller ha en samtale som alle andre mennesker. LangChain brukes til å bygge kjeder ved å lagre hver setning i samtalen og samhandle videre ved å bruke den som kontekst.

Dette innlegget vil illustrere prosessen med å bygge LLM og LLMChain i LangChain.

Hvordan bygge LLM og LLMChain i LangChain?

For å bygge LLM og LLMChain i LangChain, gå ganske enkelt gjennom de oppførte trinnene:

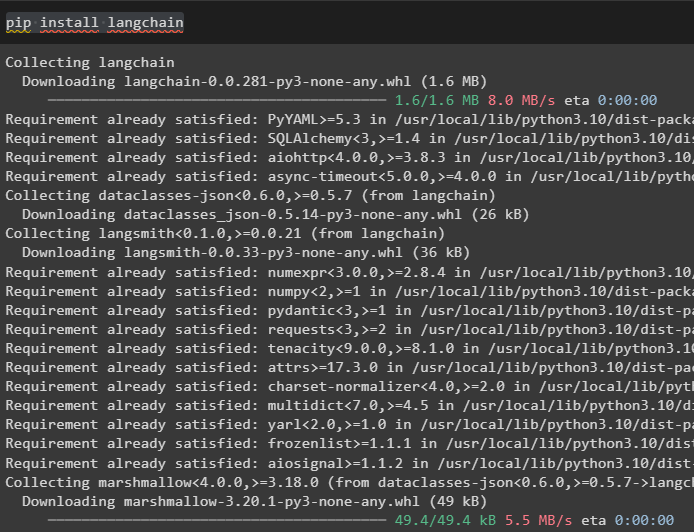

Trinn 1: Installer moduler

Installer først LangChain-modulen for å bruke bibliotekene for å bygge LLM-er og LLMChain:

pip installer langkjede

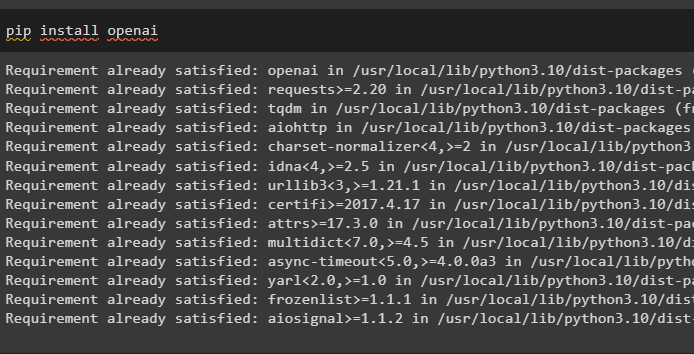

En annen modul som kreves for å bygge LLM-er er OpenAI, og den kan installeres ved å bruke pip-kommandoen:

pip installer openai

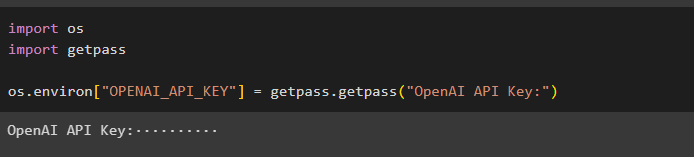

Trinn 2: Sett opp et miljø

Sett opp et miljø ved å bruke OpenAI API-nøkkelen fra miljøet:

importere ossimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

Eksempel 1: Bygg LLM-er ved å bruke LangChain

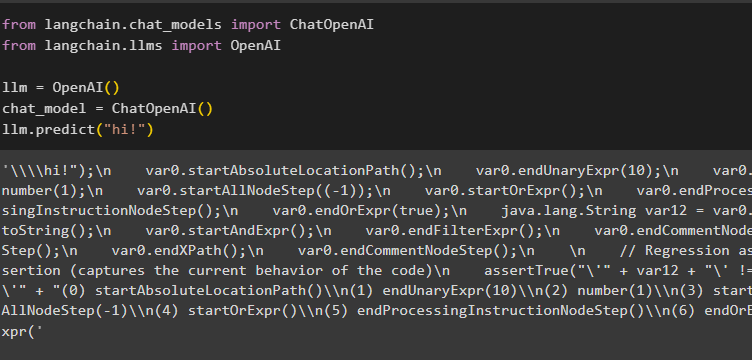

Det første eksemplet er å bygge de store språkmodellene ved å bruke LangChain ved å importere OpenAI- og ChatOpenAI-biblioteker og bruke llm()-funksjonen:

Trinn 1: Bruke LLM Chat-modellen

Importer OpenAI- og ChatOpenAI-moduler for å bygge en enkel LLM med OpenAI-miljø fra LangChain:

fra langchain.chat_models importer ChatOpenAIfra langchain.llms importerer OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('hei!')

Modellen har svart med 'hei'-svaret som vist i følgende skjermbilde nedenfor:

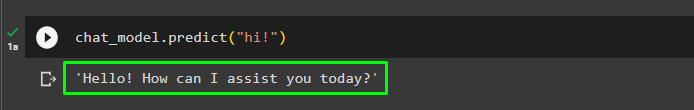

Predict()-funksjonen fra chat_modellen brukes til å få svaret eller svaret fra modellen:

chat_model.predict('hei!')Utdataene viser at modellen er til disposisjon for brukeren som spør:

Trinn 2: Bruke tekstsøk

Brukeren kan også få svar fra modellen ved å gi hele setningen i tekstvariabelen:

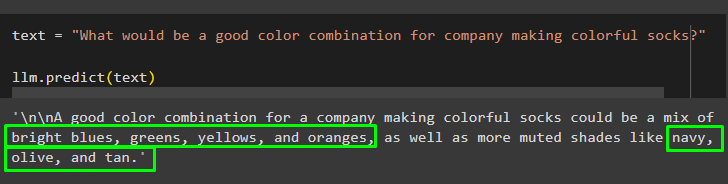

text = 'Hva ville være et godt firmanavn for et firma som lager fargerike sokker?'llm.predict(tekst)

Modellen har vist flere fargekombinasjoner for fargerike sokker:

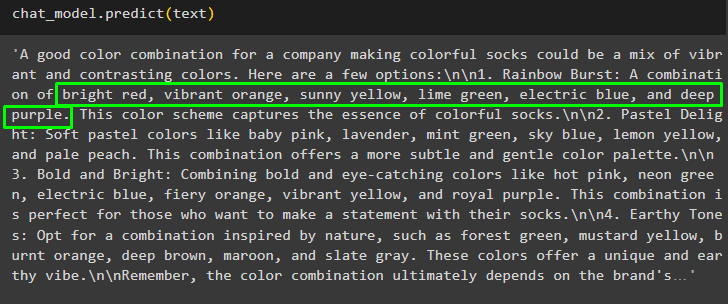

Få det detaljerte svaret fra modellen ved å bruke predict()-funksjonen med fargekombinasjonene for sokkene:

chat_model.predict(tekst)

Trinn 3: Bruke tekst med innhold

Brukeren kan få svaret med en liten forklaring om svaret:

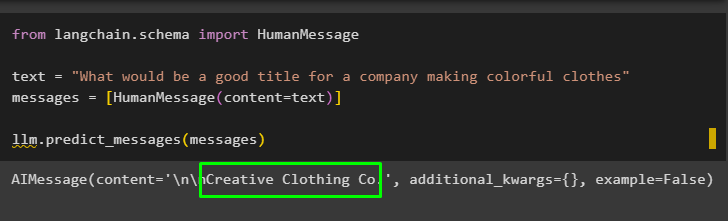

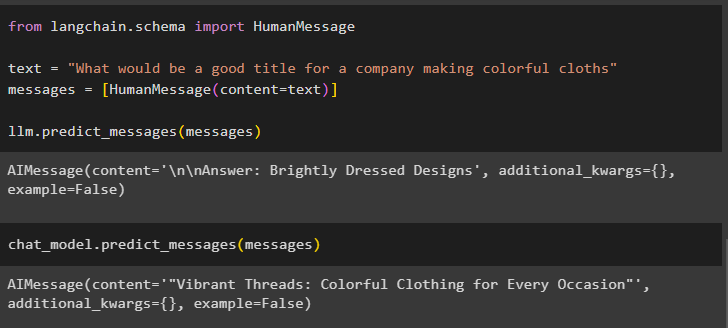

fra langchain.schema importerer HumanMessagetext = 'Hva ville være en god tittel for et selskap som lager fargerike klær'

meldinger = [HumanMessage(content=text)]

llm.predict_messages(messages)

Modellen har generert tittelen for selskapet som er 'Creative Clothing Co':

Forutsi meldingen for å få svaret for tittelen på selskapet med forklaringen også:

chat_model.predict_messages(messages)

Eksempel 2: Bygg LLMChain ved å bruke LangChain

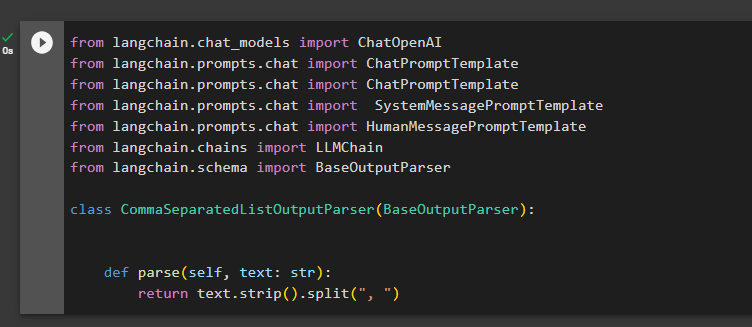

Det andre eksemplet på guiden vår bygger LLMChain for å få modellen i formatet menneskelig interaksjon for å kombinere alle trinnene fra forrige eksempel:

fra langchain.chat_models importer ChatOpenAIfra langchain.prompts.chat importer ChatPromptTemplate

fra langchain.prompts.chat importer ChatPromptTemplate

fra langchain.prompts.chat import SystemMessagePromptTemplatefra langchain.prompts.chat import HumanMessagePromptTemplate

fra langchain.chains import LLMChain

fra langchain.schema import BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(selv, tekst: str):

returner text.strip().split(', ')

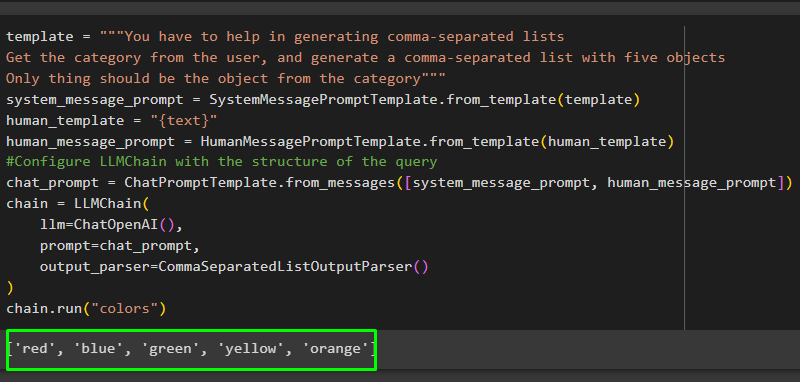

Bygg malen for chat-modellen ved å gi en detaljert forklaring på hvordan den fungerer, og bygg deretter LLMChain()-funksjonen som inneholder bibliotekene LLM, output parser og chat_prompt:

template = '''Du må hjelpe til med å generere kommaseparerte listerFå kategorien fra brukeren, og generer en kommadelt liste med fem objekter

Det eneste som skal være objektet fra kategorien'''

system_message_prompt = SystemMessagePromptTemplate.from_template(mal)

human_template = '{tekst}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Konfigurer LLMChain med strukturen til spørringen

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

kjede = LLMChain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('farger')

Modellen har gitt svaret med listen over farger da kategorien kun skal inneholde 5 objekter gitt i ledeteksten:

Det handler om å bygge LLM og LLMChain i LangChain.

Konklusjon

For å bygge LLM og LLMChain ved hjelp av LangChain, installer ganske enkelt LangChain- og OpenAI-moduler for å sette opp et miljø ved å bruke API-nøkkelen. Deretter bygger du LLM-modellen ved å bruke chat_model etter å ha opprettet ledetekstmalen for en enkelt spørring til en fullstendig chat. LLMChain brukes til å bygge kjeder av alle observasjonene i samtalen og bruke dem som konteksten for interaksjonen. Dette innlegget illustrerer prosessen med å bygge LLM og LLMChain ved å bruke LangChain-rammeverket.