LangChain er rammeverket som inneholder flere avhengigheter og biblioteker som kan brukes til å bygge store språkmodeller. Disse modellene kan brukes til å samhandle med mennesker, men først må modellen lære å få/forstå ledeteksten/spørsmålet som stilles av mennesket. For det må modellen trenes på ledetekstmalene og deretter stiller brukeren spørsmålet innenfor den gitte malen.

Denne veiledningen vil illustrere prosessen med å bygge ledetekstmaler i LangChain.

Hvordan bygge ledetekstmaler i LangChain?

For å bygge spørsmålsmaler i LangChain, gå ganske enkelt gjennom følgende veiledning med flere trinn:

Trinn 1: Installer moduler og oppsettmiljø

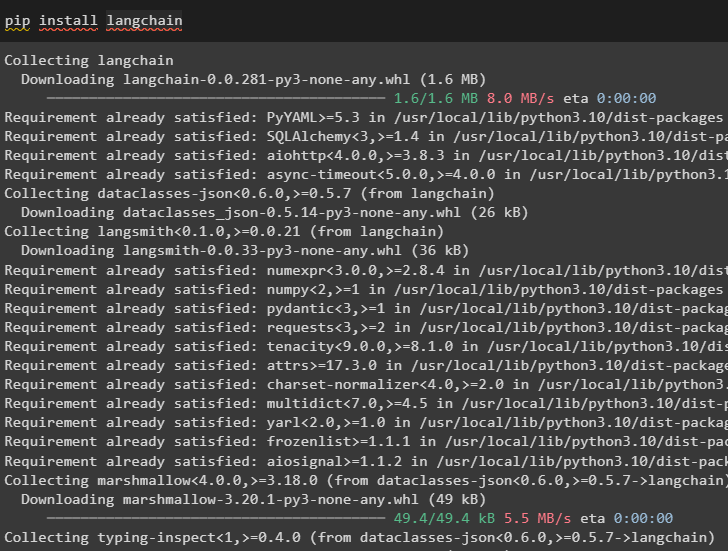

Start prosessen med å bygge spørsmålsmaler i LangChain ved å installere LangChain-rammeverket:

pip installer langkjede

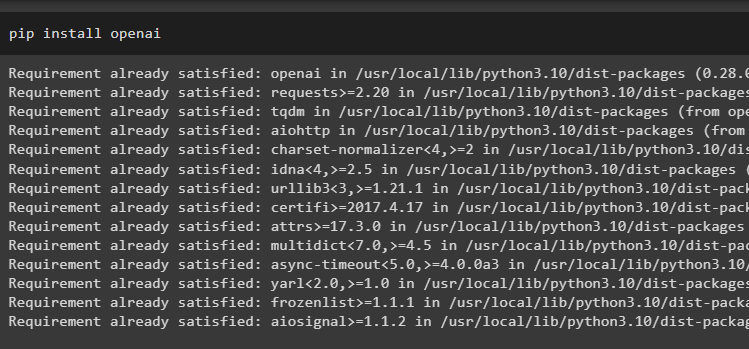

Installer nå OpenAI-moduler for å få tilgang til bibliotekene og angi et miljø med det:

pip installer openai

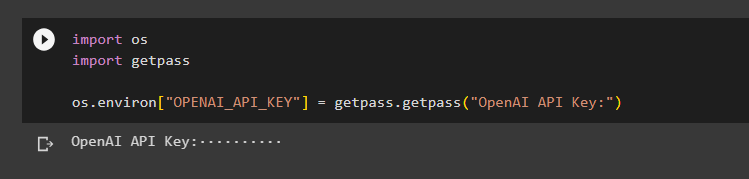

Sett opp OpenAI-miljø bruke OS-biblioteket for å få tilgang til operativsystemet og oppgi OpenAI API-nøkkelen:

importere ossimportere getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

Trinn 2: Bruke ledetekstmal

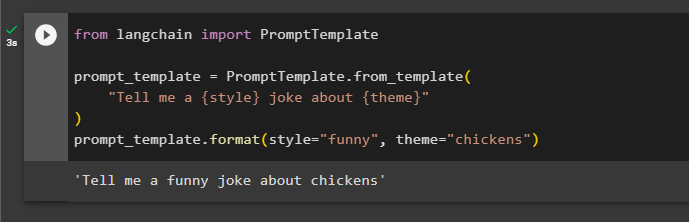

Etter å ha installert LangChain, importerer du bare PromptTemplate-biblioteket og bygger en mal for spørringen om en vits med noen ekstra aspekter som variabler som adjektiv, innhold, etc.:

fra langchain import PromptTemplateprompt_template = PromptTemplate.from_template(

'Fortell meg en {stil}-vits om {tema}'

)

prompt_template.format(style='morsom', theme='kyllinger')

Spørsmålet er satt og gitt til modellen med verdiene til variabelen satt inn i kommandoen:

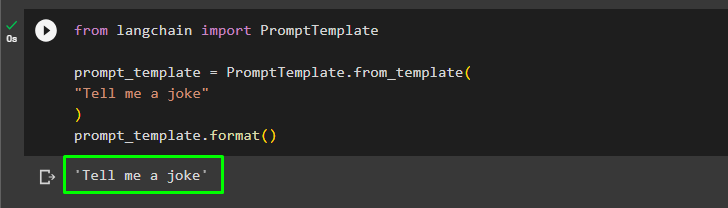

Brukeren kan tilpasse forespørselsmalen med en enkel spørring som ber om en vits:

fra langchain import PromptTemplateprompt_template = PromptTemplate.from_template(

'Fortell meg en vits'

)

prompt_mal.format()

Metoden ovenfor er for et enkelt spørsmål og svar, men noen ganger ønsker brukeren å samhandle med modellen i form av en chat, og neste avsnitt forklarer formatet.

Trinn 3: Bruke chat-promptmal

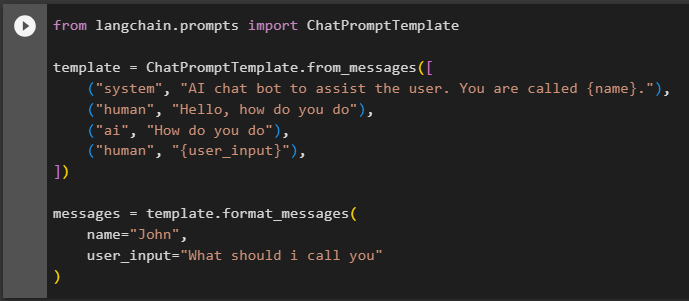

Denne delen forklarer malen for en chat-modell som er basert på et samtalemønster som to mennesker som samhandler med hverandre:

fra langchain.prompts importer ChatPromptTemplatetemplate = ChatPromptTemplate.from_messages([

('system', 'AI chat bot for å hjelpe brukeren. Du kalles {navn}.')

('menneske', 'Hei, hvordan har du det'),

('ai', 'Hvordan gjør du'),

('menneske', '{user_input}'),

])

meldinger = template.format_messages(

,

user_input='Hva skal jeg kalle deg'

)

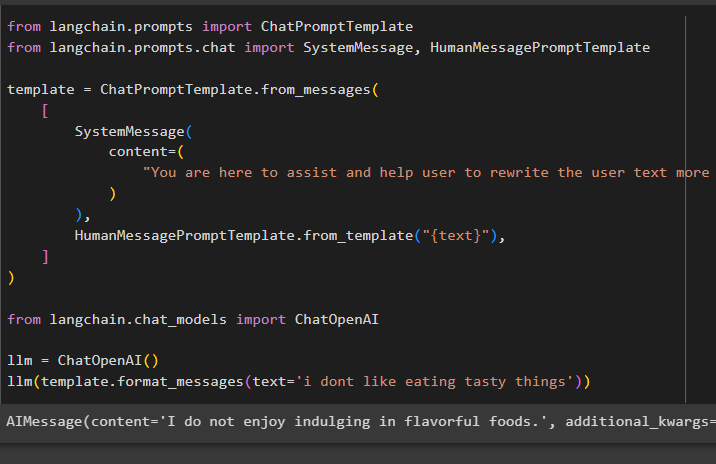

Etter å ha angitt malstrukturen, skriv ganske enkelt noen linjer i teksten for å fortelle modellen hva som forventes av den og bruk llm()-funksjonen for å gi en ledetekst:

fra langchain.prompts importer ChatPromptTemplatefra langchain.prompts.chat importer SystemMessage, HumanMessagePromptTemplate

template = ChatPromptTemplate.from_messages(

[

Systemmelding(

innhold=(

'Du er her for å hjelpe og hjelpe brukeren til å omskrive brukerteksten mer effektivt'

)

),

HumanMessagePromptTemplate.from_template('{text}'),

]

)

fra langchain.chat_models importer ChatOpenAI

llm = ChatOpenAI()

llm(template.format_messages(text='jeg liker ikke å spise velsmakende ting'))

SystemMessage()-metoden inneholder innholdet i svaret for spørringen som brukes i LLM:

Det handler om å bygge hurtigmaler i LangChain.

Konklusjon

For å bygge en ledetekstmal i LangChain, installer ganske enkelt LangChain- og OpenAI-moduler for å sette opp et miljø ved å bruke OpenAI API-nøkkelen. Deretter lager du en forespørselsmal for en enkelt forespørsel, for eksempel å be om en vits eller et enkelt spørsmål om hva som helst. En annen metode er å tilpasse en mal for en chat-modell basert på prosessen med interaksjon mellom to forskjellige mennesker. Dette innlegget har illustrert prosessen med å bygge en ledetekstmal i LangChain.