Denne artikkelen gir en trinnvis veiledning om bruk av Tokenizers i Hugging Face Transformers.

Hva er en Tokenizer?

Tokenizer er et viktig konsept for NLP, og hovedmålet er å oversette den rå teksten til tall. Det finnes ulike teknikker og metoder for dette formålet. Det er imidlertid verdt å merke seg at hver teknikk tjener et bestemt formål.

Hvordan bruke tokenizers i Hugging Face Transformers?

Hvordan bruke tokenizers i Hugging Face Transformers?

Tokenizer-biblioteket må først installeres før du bruker det og importerer funksjoner fra det. Deretter trener du en modell ved hjelp av AutoTokenizer, og gir deretter inndata for å utføre tokenisering.

Hugging Face introduserer tre hovedkategorier av tokenisering som er gitt nedenfor:

- Ordbasert Tokenizer

- Karakterbasert Tokenizer

- Underord-basert Tokenizer

Her er en trinn-for-trinn-guide for å bruke Tokenizers i Transformers:

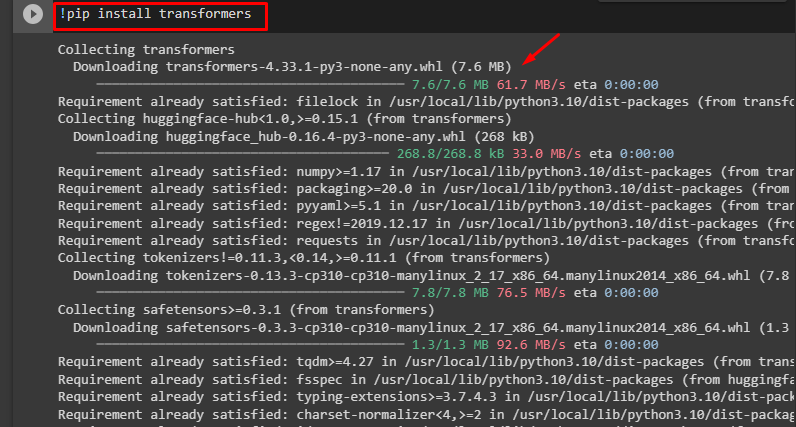

Trinn 1: Installer Transformers

For å installere transformatorer, bruk pip-kommandoen i følgende kommando:

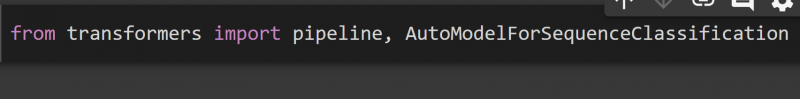

Trinn 2: Importer klasser

Fra transformatorer, import rørledning , og AutoModelForSequenceClassification bibliotek for å utføre klassifisering:

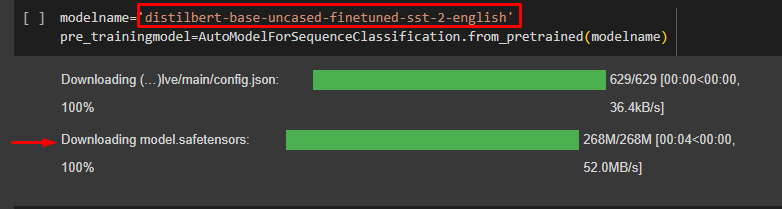

Trinn 3: Importer modell

« AutoModelForSequenceClassification ” er en metode som tilhører Auto-Class for tokenisering. De from_pretrained() metoden brukes for å returnere riktig modellklasse basert på modelltypen.

Her har vi gitt navnet på modellen i ' modell navn variabel:

modell navn = 'distilbert-base-uncased-finetuned-sst-2-engelsk'pre_trainingmodel =AutoModelForSequenceClassification.from_pretrained ( modell navn )

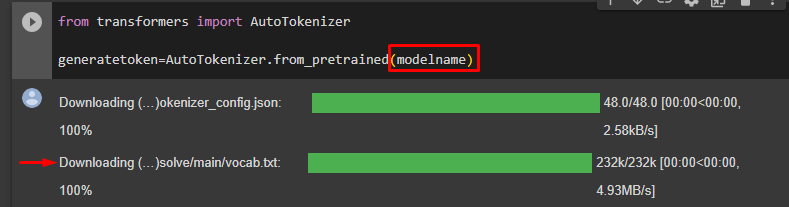

Trinn 4: Importer AutoTokenizer

Oppgi følgende kommando for å generere tokens ved å sende ' modell navn ' som argumentet:

det genererte tokenet =AutoTokenizer.from_pretrained ( modell navn )

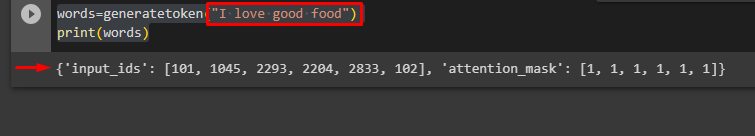

Trinn 5: Generer token

Nå vil vi generere tokens på en setning “Jeg elsker god mat” ved å bruke ' det genererte tokenet variabel:

skrive ut ( ord )

Utgangen er gitt som følger:

Koden til ovenstående Google Co er gitt her.

Konklusjon

For å bruke Tokenizers i Hugging Face, installer biblioteket ved å bruke pip-kommandoen, tren en modell ved å bruke AutoTokenizer, og gi deretter inndata for å utføre tokenisering. Ved å bruke tokenisering, tilordne vekter til ordene basert på de er sekvensert for å beholde betydningen av setningen. Denne poengsummen bestemmer også verdien for analyse. Denne artikkelen er en detaljert veiledning om hvordan du bruker Tokenizers i Hugging Face Transformers.