LangChain er rammeverket som kan brukes til å importere biblioteker og avhengigheter for å bygge store språkmodeller eller LLM-er. Språkmodellene bruker minne til å lagre data eller historikk i databasen som observasjon for å få konteksten til samtalen. Minnet er konfigurert til å lagre de siste meldingene, slik at modellen kan forstå de tvetydige spørsmålene som er gitt av brukeren.

Denne bloggen forklarer prosessen med å bruke minne i LLMChain gjennom LangChain.

Hvordan bruke minne i LLMChain gjennom LangChain?

For å legge til minne og bruke det i LLMChain gjennom LangChain, kan ConversationBufferMemory-biblioteket brukes ved å importere det fra LangChain.

For å lære prosessen med å bruke minnet i LLMChain gjennom LangChain, gå gjennom følgende veiledning:

Trinn 1: Installer moduler

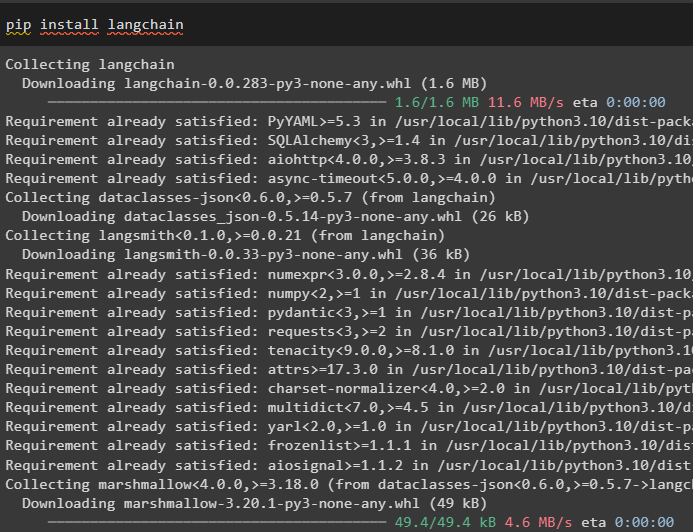

Start først prosessen med å bruke minnet ved å installere LangChain ved å bruke pip-kommandoen:

pip installer langkjede

Installer OpenAI-modulene for å få avhengighetene eller bibliotekene til å bygge LLM-er eller chattemodeller:

pip installer openai

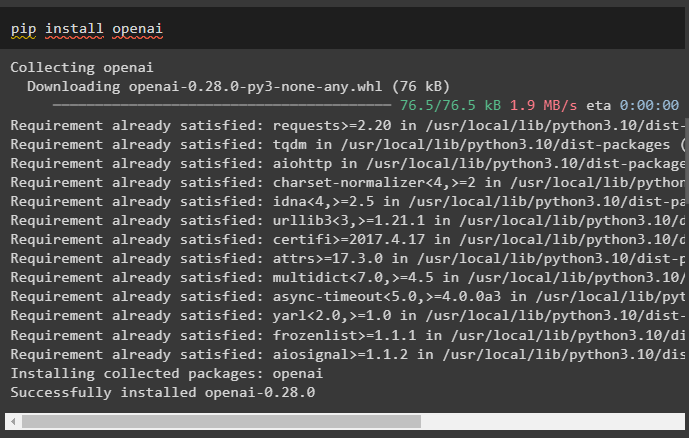

Sett opp miljøet for OpenAI ved å bruke API-nøkkelen ved å importere OS- og getpass-bibliotekene:

importere ossimportere getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

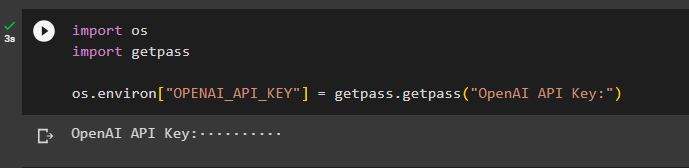

Trinn 2: Importere biblioteker

Etter å ha satt opp miljøet, importerer du bare bibliotekene som ConversationBufferMemory fra LangChain:

fra langchain.chains import LLMChainfra langchain.llms importerer OpenAI

fra langchain.memory import ConversationBufferMemory

fra langchain.prompts importer PromptTemplate

Konfigurer malen for ledeteksten ved å bruke variabler som 'input' for å få spørringen fra brukeren og 'hist' for å lagre dataene i bufferminnet:

template = '''Du er en modell som snakker med et menneske{histo}

Menneske: {input}

Chatbot:'''

prompt = PromptTemplate(

input_variables=['hist', 'input'], template=mal

)

minne = ConversationBufferMemory(memory_key='hist')

Trinn 3: Konfigurere LLM

Når malen for spørringen er bygget, konfigurer LLMChain()-metoden ved å bruke flere parametere:

llm = OpenAI()llm_chain = LLMChain(

llm=llm,

prompt = ledetekst,

verbose=Sant,

minne = minne,

)

Trinn 4: Testing av LLMChain

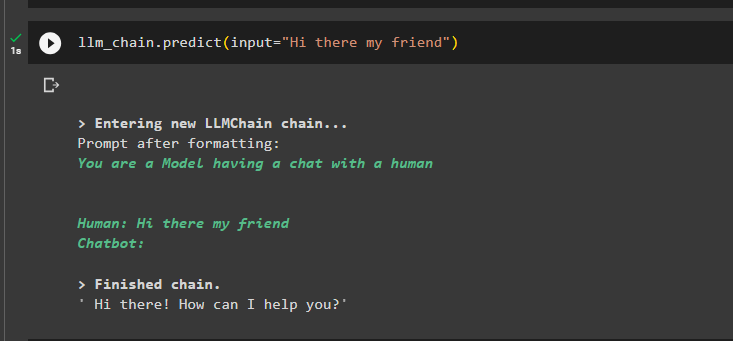

Deretter tester du LLMChain ved å bruke inngangsvariabelen for å få forespørselen fra brukeren i tekstform:

llm_chain.predict(input='Hei min venn')

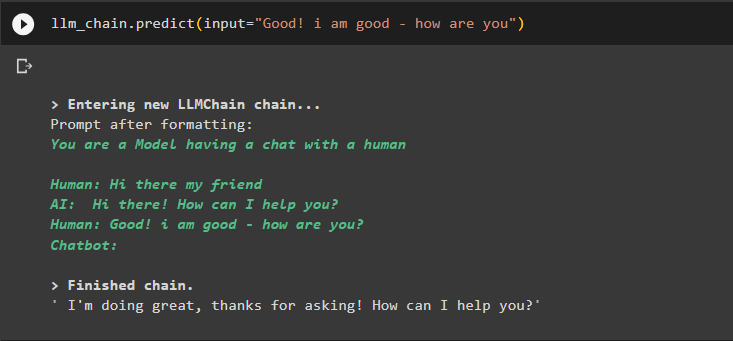

Bruk en annen inngang for å få dataene lagret i minnet for å trekke ut utdata ved å bruke konteksten:

llm_chain.predict(input='Bra! jeg er god - hvordan har du det')

Trinn 5: Legge til minne til en chat-modell

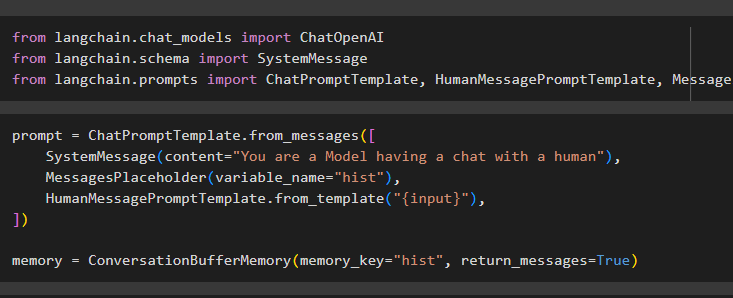

Minnet kan legges til den chat-modellbaserte LLMChain ved å importere bibliotekene:

fra langchain.chat_models importer ChatOpenAIfra langchain.schema import SystemMessage

fra langchain.prompts importer ChatPromptTemplate, HumanMessagePromptTemplate, MessagesPlaceholder

Konfigurer ledetekstmalen ved å bruke ConversationBufferMemory() ved å bruke forskjellige variabler for å angi inndata fra brukeren:

prompt = ChatPromptTemplate.from_messages([SystemMessage(content='Du er en modell som prater med et menneske'),

MessagesPlaceholder(variable_),

HumanMessagePromptTemplate.from_template('{input}'),

])

minne = ConversationBufferMemory(memory_key='hist', return_messages=True)

Trinn 6: Konfigurere LLMChain

Sett opp LLMChain()-metoden for å konfigurere modellen ved å bruke forskjellige argumenter og parametere:

llm = ChatOpenAI()chat_llm_chain = LLMChain(

llm=llm,

prompt=spørring,

verbose=Sant,

minne = minne,

)

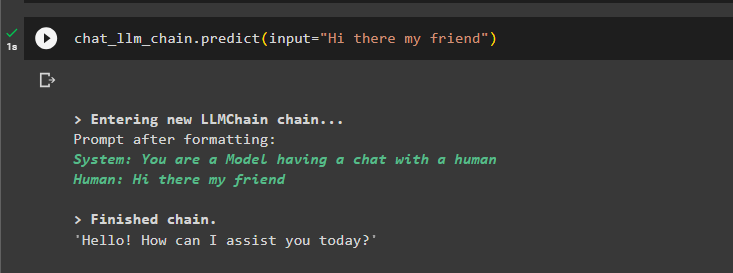

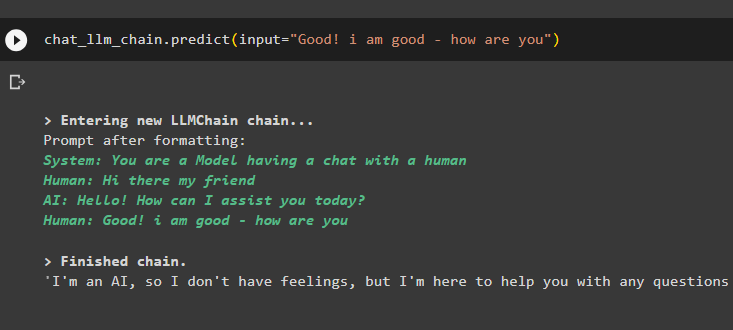

Trinn 7: Testing av LLMChain

På slutten tester du bare LLMChain ved å bruke inngangen slik at modellen kan generere teksten i henhold til ledeteksten:

chat_llm_chain.predict(input='Hei min venn')

Modellen har lagret den forrige samtalen i minnet og viser den før den faktiske utgangen av spørringen:

llm_chain.predict(input='Bra! jeg er god - hvordan har du det')

Det handler om å bruke minne i LLMChain ved å bruke LangChain.

Konklusjon

For å bruke minnet i LLMChain gjennom LangChain-rammeverket, installer ganske enkelt modulene for å sette opp miljøet for å få avhengighetene fra modulene. Etter det importerer du bare bibliotekene fra LangChain for å bruke bufferminnet til å lagre den forrige samtalen. Brukeren kan også legge til minne til chat-modellen ved å bygge LLMChain og deretter teste kjeden ved å gi input. Denne veiledningen har utdypet prosessen med å bruke minnet i LLMChain gjennom LangChain.